Touradj Ebrahimi, professeur de l'EPFL, et Anthony Sahakian, CEO de Quantum Integrity, collaborent pour sortir un logiciel de détection des deepfake universel.© 2019 Alain Herzog

Barak Obama insultant Donald Trump, ce dernier accusant son prédécesseur de vol, ou encore Mark Zuckerberg tenant des propos inquiétants sur l’utilisation des données: les vidéos truquées grâce à l’intelligence artificielle ont engendré de nombreux buzz ces dernières années. Quelques détails tels que l’absence de clignement des yeux permettaient encore il y a peu de distinguer ces supercheries. Connues sous le nom de deepfake, ces vidéos atteignent aujourd’hui un tel niveau de vraisemblance que cela devient illusoire de s’y risquer. Inquiets devant les dérives amenées à se multiplier et dynamisés par le domaine à défricher, divers entrepreneurs, gouvernements et chercheurs ont récemment empoigné le problème.

Etoffer un détecteur à deepfake existant

Le Groupe de traitement du signal multimédia à l’EPFL et la start-up Quantum Integrity, basée au parc de l’innovation du campus, travaillent depuis deux ans à un programme de discrimination. Forts de deux projets pilotes, ils ont obtenu un financement d’Innosuisse – l'Agence suisse pour l'encouragement de l'innovation – qui débutera officiellement le 1er octobre, afin de booster le développement de ce logiciel. « Quantum Integrity a déjà un logiciel opérationnel qui est commercialisé. Notre travail visera à étoffer ce détecteur afin de le rendre plus universel », souligne Touradj Ebrahimi, directeur du groupe de recherche de l’EPFL. Affilié au Centre pour la confiance numérique (C4DT) le professeur y coordonne le domaine Information numérique. « La détection des contrefaçons d'images et de vidéos afin de lutter contre les manipulations malveillantes est clairement l'une des applications où l'intelligence artificielle permet de regagner la confiance », explique Olivier Crochat, directeur exécutif du C4DT.

L’avantage d’avoir des données réelles

Entre les créateurs d’algorithmes de trucage et les spécialistes anti-deepfake, c’est le jeu du chat et de la souris. Comme pour tout type de contrefaçons, les premiers ont par principe une longueur d’avance puisqu’ils contournent les nouveaux obstacles au fur et à mesure. Ceux qui tentent de les démasquer travaillent sur les résultats existants. À peine la nouvelle s’est répandue par exemple que certains points autour de la bouche ne bougeaient pas naturellement sur les faux et permettait ainsi de flairer la supercherie qu’un algorithme palliant à cette imperfection a été mis au point. C’est à ce cercle vicieux que Touradj Ebrahimi, responsable du laboratoire, et Anthony Sahakian, CEO de la start-up, s’attaquent.

Face à la concurrence d’autres groupes de recherche qui se sont saisi du problème ces derniers mois et au risque de plagiat, les protagonistes ne souhaitent pour l’instant pas divulguer grand-chose de la technologie qu’ils utilisent. « Mais, soulignent-ils, il s’agit d’une intelligence artificielle qui permet de rester en permanence en phase avec l’amélioration des trucages ». Le Laboratoire apporte toute son expertise glanée autour du traitement du signal multimédia, alors que la start-up travaille depuis plusieurs années sur la détection de photos truquées.

Les deepfake sont également un problème pour l’industrie

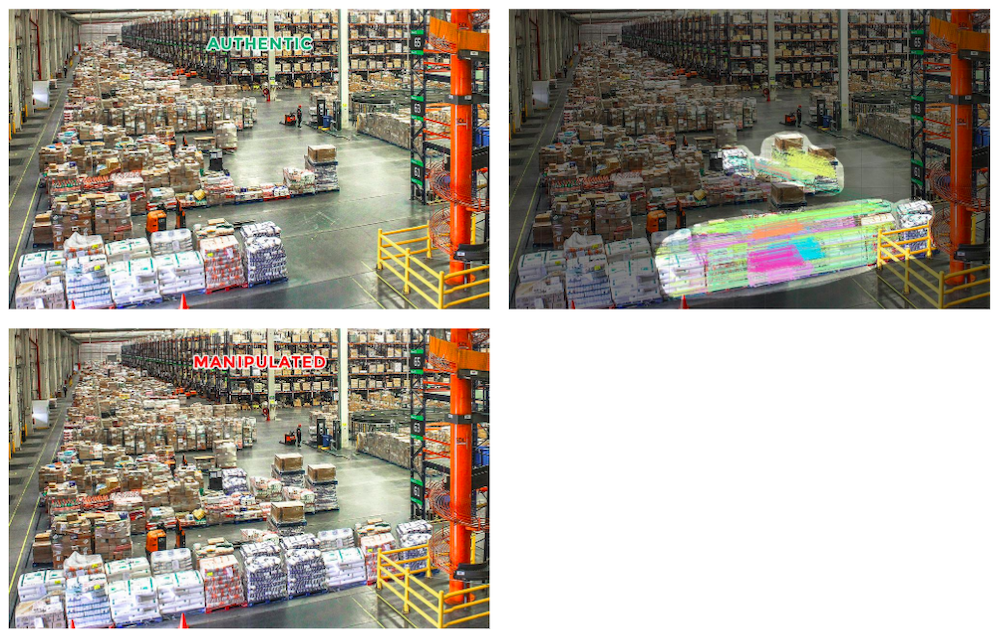

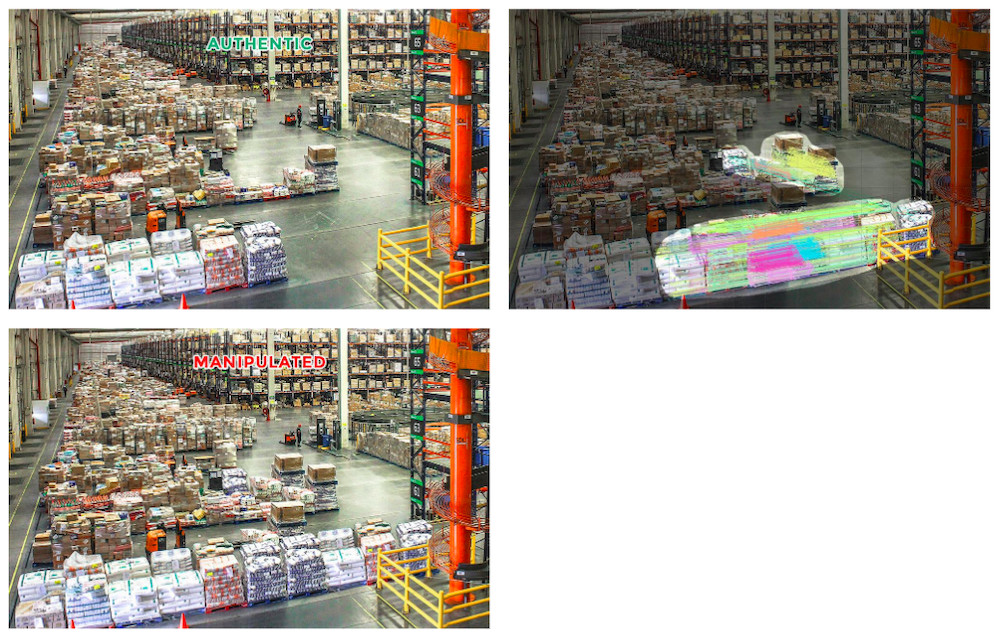

Le problème des deepfake s’est fait connaître du grand public principalement sous l’angle de l’usurpation d’identité, mais il est bien plus large que cela et touche également l’industrie, les douanes et les assurances par exemple. Il n’est ainsi pas rare que de la marchandise soit ajoutée ou enlevée avant son départ en cargo. Or la validation des transactions s’établit souvent sur la base de photos qui peuvent être truquées.

Le Groupe de traitement du signal multimédia à l’EPFL et la start-up Quantum Integrity, basée au parc de l’innovation du campus, travaillent depuis deux ans à un programme de discrimination. Forts de deux projets pilotes, ils ont obtenu un financement d’Innosuisse – l'Agence suisse pour l'encouragement de l'innovation – qui débutera officiellement le 1er octobre, afin de booster le développement de ce logiciel. « Quantum Integrity a déjà un logiciel opérationnel qui est commercialisé. Notre travail visera à étoffer ce détecteur afin de le rendre plus universel », souligne Touradj Ebrahimi, directeur du groupe de recherche de l’EPFL. Affilié au Centre pour la confiance numérique (C4DT) le professeur y coordonne le domaine Information numérique. « La détection des contrefaçons d'images et de vidéos afin de lutter contre les manipulations malveillantes est clairement l'une des applications où l'intelligence artificielle permet de regagner la confiance », explique Olivier Crochat, directeur exécutif du C4DT.

L’avantage d’avoir des données réelles

Entre les créateurs d’algorithmes de trucage et les spécialistes anti-deepfake, c’est le jeu du chat et de la souris. Comme pour tout type de contrefaçons, les premiers ont par principe une longueur d’avance puisqu’ils contournent les nouveaux obstacles au fur et à mesure. Ceux qui tentent de les démasquer travaillent sur les résultats existants. À peine la nouvelle s’est répandue par exemple que certains points autour de la bouche ne bougeaient pas naturellement sur les faux et permettait ainsi de flairer la supercherie qu’un algorithme palliant à cette imperfection a été mis au point. C’est à ce cercle vicieux que Touradj Ebrahimi, responsable du laboratoire, et Anthony Sahakian, CEO de la start-up, s’attaquent.

Face à la concurrence d’autres groupes de recherche qui se sont saisi du problème ces derniers mois et au risque de plagiat, les protagonistes ne souhaitent pour l’instant pas divulguer grand-chose de la technologie qu’ils utilisent. « Mais, soulignent-ils, il s’agit d’une intelligence artificielle qui permet de rester en permanence en phase avec l’amélioration des trucages ». Le Laboratoire apporte toute son expertise glanée autour du traitement du signal multimédia, alors que la start-up travaille depuis plusieurs années sur la détection de photos truquées.

Les deepfake sont également un problème pour l’industrie

Le problème des deepfake s’est fait connaître du grand public principalement sous l’angle de l’usurpation d’identité, mais il est bien plus large que cela et touche également l’industrie, les douanes et les assurances par exemple. Il n’est ainsi pas rare que de la marchandise soit ajoutée ou enlevée avant son départ en cargo. Or la validation des transactions s’établit souvent sur la base de photos qui peuvent être truquées.

Pour façonner son système d’apprentissage, la solution en phase d’élaboration s’appuie sur une grande collection de données réelles accumulées par la start-up, ce qui lui donne un avantage sur ses concurrents. À terme, la plateforme permettra d’uploader une vidéo pour savoir rapidement quels éléments ont été modifiés ou ajoutés.

Une menace pour les réseaux sociaux

La création de ce logiciel anti-deepfake intervient à point nommé car la création des contenus falsifiés se démocratise. Une application chinoise disponible dans quelques pays pour le moment, Zao, permet depuis fin août de produire un deepfake au résultat bluffant sur la base de quelques clichés. Facebook a récemment annoncé un investissement de 10 millions de dollars pour développer un programme de détection des faux dont les détails seront connus en fin d’année. L’entreprise a lancé un concours auprès de diverses universités américaines afin de trouver la meilleure solution face à ce qui pourrait devenir un fléau notamment pour les réseaux sociaux. Adaptable à tous les domaines, des photos industrielles aux visages, la solution développée à l’EPFL pourrait se profiler sur ce concours. « Il faudra cependant que nous en sachions davantage sur les procédures d’évaluation et les conditions de participation, notamment les droits de propriété intellectuelle liés», souligne Touradj Ebrahimi.

Une menace pour les réseaux sociaux

La création de ce logiciel anti-deepfake intervient à point nommé car la création des contenus falsifiés se démocratise. Une application chinoise disponible dans quelques pays pour le moment, Zao, permet depuis fin août de produire un deepfake au résultat bluffant sur la base de quelques clichés. Facebook a récemment annoncé un investissement de 10 millions de dollars pour développer un programme de détection des faux dont les détails seront connus en fin d’année. L’entreprise a lancé un concours auprès de diverses universités américaines afin de trouver la meilleure solution face à ce qui pourrait devenir un fléau notamment pour les réseaux sociaux. Adaptable à tous les domaines, des photos industrielles aux visages, la solution développée à l’EPFL pourrait se profiler sur ce concours. « Il faudra cependant que nous en sachions davantage sur les procédures d’évaluation et les conditions de participation, notamment les droits de propriété intellectuelle liés», souligne Touradj Ebrahimi.

Autres articles

-

Une politique globale sur les données est nécessaire afin d’en préserver les avantages économiques et sociaux pour le pays et ses citoyennes et citoyens, conclut une étude du Center for Digital Trust de l'EPFL

-

IA: comment trouver la voie d'un modèle responsable

-

Un nouveau modèle de langage d'IA qui imite l'organisation du cerveau

-

L'IA pour surveiller et détecter les défauts des infrastructures

-

Des synapses nanofluidiques pour stocker la mémoire computationelle